Transfer Learning là gì? Khám phá sức mạnh học chuyển giao AI

Transfer Learning là gì? Đây là một kỹ thuật quan trọng trong trí tuệ nhân tạo, cho phép tận dụng kiến thức từ mô hình đã được huấn luyện để áp dụng vào bài toán mới. Bài viết dưới đây Bizfly sẽ cùng bạn tìm hiểu hiểu rõ khái niệm, các phương pháp phổ biến, quy trình triển khai cũng như ưu nhược điểm của Transfer Learning trong thực tiễn.

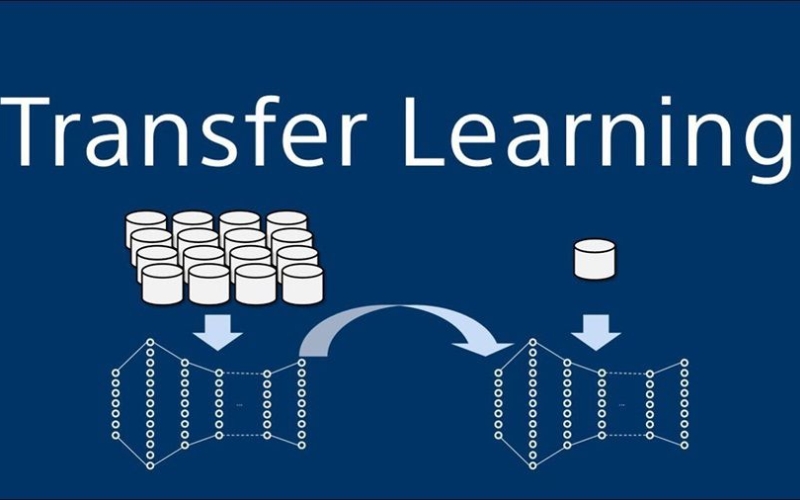

Transfer Learning là gì?

Transfer Learning là chỉ phương pháp trong học máy (Machine Learning) cho phép tận dụng kiến thức từ một nhiệm vụ đã học để giải quyết nhiệm vụ mới. Thay vì huấn luyện mô hình từ đầu, nó dùng các mô hình đã được đào tạo trên tập dữ liệu lớn và chuyển giao đặc trưng sang bài toán khác, giúp tiết kiệm thời gian, tài nguyên và tăng hiệu quả.

Ví dụ, một mô hình nhận diện khuôn mặt đã huấn luyện sẵn có thể hỗ trợ quá trình xây dựng hệ thống phân loại động vật, thay vì phải đào tạo từ đầu. Trong thị giác máy tính, một mô hình học cách phân biệt ô tô hoàn toàn có thể được tinh chỉnh (fine-tuning) để nhận diện xe máy, bởi cả hai đều thuộc nhóm phương tiện giao thông và có những đặc điểm tương đồng.

Các phương pháp chính trong Transfer Learning

Khi tìm hiểu Transfer Learning là gì?, bạn sẽ thấy có nhiều phương pháp giúp tận dụng kiến thức từ mô hình đã học để áp dụng cho bài toán mới. Các phương pháp chính bao gồm trích xuất đặc trưng, tinh chỉnh, học đa nhiệm và học dựa trên miền, mỗi phương pháp đều có cách triển khai và ứng dụng riêng.

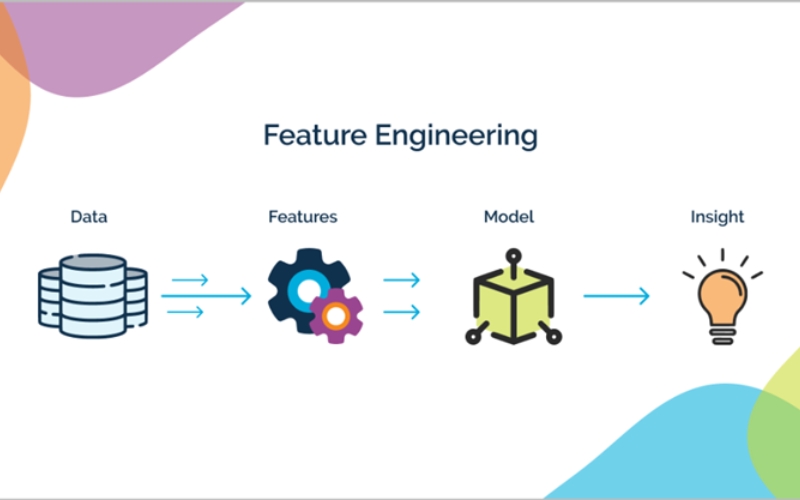

Trích xuất đặc trưng (Feature Extraction)

Trích xuất đặc trưng là phương pháp sử dụng mô hình đã huấn luyện sẵn như một bộ trích xuất cố định. Các trọng số của mô hình được giữ nguyên, và chỉ tận dụng các đặc trưng đã học để áp dụng cho dữ liệu mới. Phương pháp này giúp tiết kiệm thời gian, giảm chi phí tính toán nhưng vẫn đạt hiệu quả cao, đặc biệt khi dữ liệu mới hạn chế.

Cách thực hiện:

- Khởi tạo từ mô hình tiền huấn luyện trên tập dữ liệu lớn, ví dụ như ImageNet.

- Giữ nguyên trọng số tất cả các lớp (đóng băng các lớp).

- Thêm các lớp đầu ra mới phù hợp với nhiệm vụ và huấn luyện các lớp này dựa trên đặc trưng đã trích xuất.

Ứng dụng thực tế:

Phương pháp trích xuất đặc trưng được áp dụng rộng rãi, chẳng hạn như phát hiện bất thường trong ảnh y khoa khi dữ liệu nhãn hạn chế, phân tích ảnh vệ tinh để giám sát môi trường như phát hiện phá rừng, hay phân loại cảm xúc và chủ đề trong văn bản với bộ dữ liệu nhỏ.

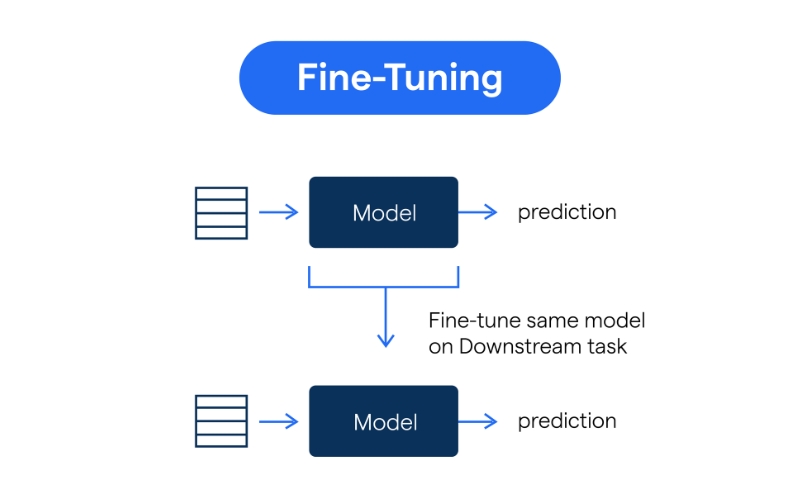

Tinh chỉnh (Fine-tuning)

Fine-tuning là bước nâng cao của Transfer Learning, không chỉ thêm lớp mới mà còn điều chỉnh lại một phần trọng số của mô hình tiền huấn luyện. Phương pháp này giúp mô hình thích nghi tốt hơn với dữ liệu và nhiệm vụ mới, nâng cao độ chính xác khi có đủ dữ liệu huấn luyện.

Cách thực hiện:

- Bắt đầu từ mô hình tiền huấn luyện đã học trên tập dữ liệu lớn.

- Mở khóa một số lớp để trọng số của chúng có thể được cập nhật trong quá trình huấn luyện.

- Huấn luyện đồng thời các lớp mở khóa và các lớp mới trên dữ liệu nhiệm vụ mới

Ứng dụng thực tế:

Trong thị giác máy tính, mô hình nhận diện ô tô có thể được tinh chỉnh để nhận diện xe máy hoặc các loại phương tiện khác. Trong y học, mô hình phân tích ảnh MRI hay X-quang có thể fine-tuning để phát hiện bệnh lý cụ thể. Trong xử lý ngôn ngữ, mô hình ngôn ngữ tiền huấn luyện có thể tinh chỉnh để phân loại cảm xúc, nhận diện chủ đề hoặc dịch ngôn ngữ.

Học đa nhiệm (Multi-task Learning)

Học đa nhiệm là phương pháp huấn luyện mô hình thực hiện nhiều nhiệm vụ cùng lúc trên cùng một tập dữ liệu. Thay vì xây dựng riêng biệt từng mô hình cho mỗi nhiệm vụ, Multi-task Learning tận dụng mối quan hệ giữa các nhiệm vụ để cải thiện hiệu suất tổng thể và tiết kiệm tài nguyên huấn luyện.

Ví dụ, Trong xe tự hành, mô hình phải nhận diện nhiều đối tượng cùng lúc như biển báo, vạch đường, người đi bộ, đèn tín hiệu và phương tiện khác. Trong thời trang, mô hình phân loại sản phẩm theo màu sắc, giới tính, độ tuổi và mùa mặc, giúp tăng độ chính xác và tiết kiệm thời gian.

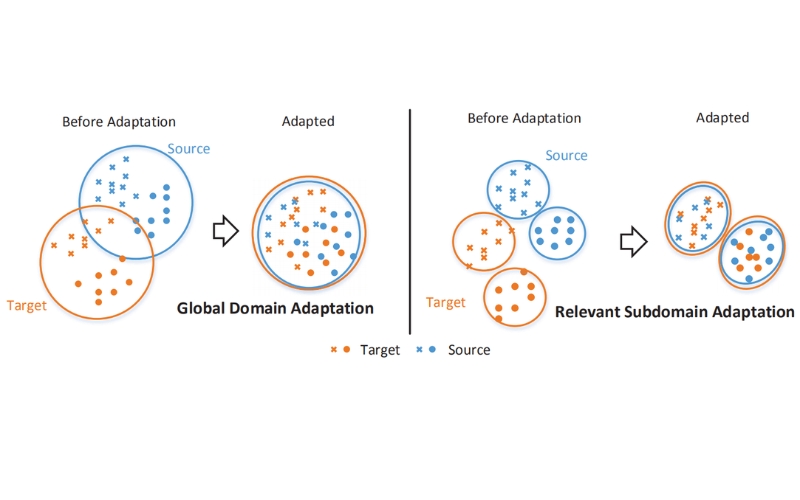

Học dựa trên miền (Domain Adaptation)

Học dựa trên miền là kỹ thuật chuyển kiến thức từ một miền dữ liệu sang miền khác nhưng cùng nhiệm vụ, giúp mô hình giữ hiệu suất khi áp dụng trong môi trường mới. Ví dụ, mô hình phân loại đánh giá nhà hàng có thể điều chỉnh để phân loại đánh giá phim hay sản phẩm mà không cần huấn luyện lại từ đầu.

Các mô hình tiền huấn luyện phổ biến

Để hiểu Transfer Learning, cần nắm rõ mô hình tiền huấn luyện - nền tảng được đào tạo trên dữ liệu lớn và có thể tái sử dụng, tinh chỉnh cho nhiều nhiệm vụ. Hai mô hình phổ biến nhất là thị giác máy tính và xử lý ngôn ngữ tự nhiên.

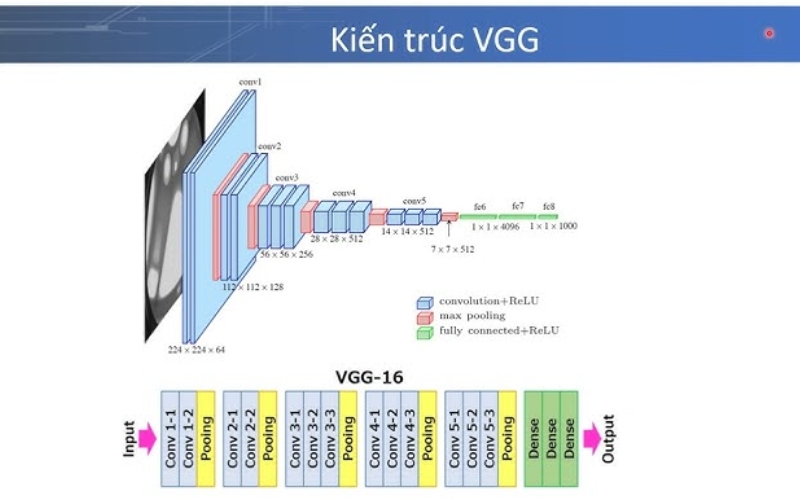

Trong thị giác máy tính (Computer Vision)

Các mô hình tiền huấn luyện trong thị giác máy tính giúp rút ngắn thời gian phát triển và nâng cao hiệu quả nhận diện hình ảnh:

- VGGNet: Mạng sâu nhưng đơn giản, sử dụng các lớp tích chập liên tiếp để trích xuất đặc trưng hình ảnh, rất hiệu quả trong phân loại ảnh cơ bản.

- ResNet: Việc áp dụng các khối dư giúp huấn luyện mạng nhiều tầng hiệu quả hơn, tránh hiện tượng mất dần độ dốc và phù hợp với những nhiệm vụ phức tạp.

- Inception (GoogLeNet): Kiến trúc đa chiều học đặc trưng ở nhiều mức độ khác nhau, cải thiện khả năng nhận diện đa loại đối tượng.

- EfficientNet: Cân bằng giữa độ sâu, độ rộng và độ phân giải mạng, tối ưu hiệu suất và tiết kiệm tài nguyên tính toán.

- YOLO (You Only Look Once): Nhận diện và phát hiện đối tượng trong thời gian thực, phổ biến trong giám sát video và xe tự hành.

- U-Net: Thường dùng trong phân đoạn ảnh y khoa, giúp xác định chính xác khu vực quan tâm mà không cần dữ liệu nhãn quá lớn.

Trong xử lý ngôn ngữ tự nhiên (NLP)

Trong NLP, các mô hình tiền huấn luyện giúp hiểu ngữ nghĩa và ngữ cảnh từ dữ liệu lớn, từ đó phục vụ nhiều tác vụ khác nhau:

- Word2Vec và GloVe: Biểu diễn từ dưới dạng vector, giúp mô hình hiểu ngữ nghĩa và quan hệ giữa các từ.

- BERT (Bidirectional Encoder Representations from Transformers): Học ngữ cảnh hai chiều, nâng cao hiệu suất trong phân loại văn bản, trả lời câu hỏi.

- GPT (Generative Pre-trained Transformer): Tạo văn bản tự nhiên, dùng cho chatbot, tạo nội dung tự động hoặc viết văn bản dựa trên ngữ cảnh.

- RoBERTa: Phiên bản cải tiến của BERT với kỹ thuật huấn luyện nâng cao, tăng khả năng tổng quát hóa trong nhiều nhiệm vụ.

- T5 (Text-to-Text Transfer Transformer): Chuyển tất cả các nhiệm vụ NLP thành bài toán chuyển đổi văn bản, giúp mô hình linh hoạt áp dụng nhiều tác vụ khác nhau.

Các bước triển khai Transfer Learning hiệu quả

Để tận dụng tối đa sức mạnh của Transfer Learning, việc triển khai theo các bước hợp lý là rất quan trọng. Khi hiểu rõ Transfer Learning là gì và áp dụng ứng dụng Transfer Learning đúng cách, bạn sẽ có được một mô hình vừa tối ưu, vừa đảm bảo độ chính xác cao trên dữ liệu mục tiêu.

Bước 1: Chọn mô hình tiền huấn luyện

Đầu tiên, bạn cần lựa chọn một mô hình đã được huấn luyện sẵn phù hợp với bài toán. Các mô hình này thường được huấn luyện trên tập dữ liệu lớn như ImageNet hoặc tập văn bản khổng lồ, với kiến trúc phức tạp. Khi chọn, cần cân nhắc kiến trúc mô hình, tập dữ liệu gốc liên quan đến bài toán, và khả năng xử lý của hệ thống.

Bước 2: Chuẩn bị dữ liệu

Sau khi chọn mô hình, dữ liệu cho nhiệm vụ mới cần được chuẩn bị kỹ lưỡng, bao gồm việc làm sạch, gán nhãn đầy đủ và tiền xử lý phù hợp như resize ảnh, chuẩn hóa hoặc tokenization trong NLP. Dữ liệu chất lượng cao giúp mô hình học nhanh hơn, tránh overfitting và đạt hiệu suất tối ưu trên tập kiểm thử.

Bước 3: Tùy chỉnh mô hình

Tiếp theo, mô hình tiền huấn luyện cần được điều chỉnh để phù hợp với nhiệm vụ cụ thể. Thông thường, các lớp cuối được thay thế bằng các lớp mới tương ứng với số lượng lớp đầu ra của bài toán. Tùy vào phương pháp mà bạn có thể đóng băng một số lớp cũ hoặc mở khóa để tinh chỉnh, nhằm vừa giữ lại kiến thức cũ vừa học thêm các đặc trưng mới.

Bước 4: Huấn luyện (Fine-tuning) mô hình

Bước cuối cùng là huấn luyện lại mô hình trên dữ liệu mới. Quá trình này, gọi là fine-tuning, tập trung cập nhật các lớp mới và một phần các lớp cuối cùng của mô hình gốc. Tốc độ học thường được cài đặt thấp hơn để bảo toàn kiến thức cũ và đạt hiệu quả tối ưu trên nhiệm vụ mới.

Ưu và nhược điểm của Transfer Learning

Transfer Learning mang lại nhiều lợi ích trong việc rút ngắn thời gian huấn luyện và tăng hiệu quả mô hình, nhưng cũng có một số hạn chế cần lưu ý. Việc hiểu rõ ưu nhược điểm giúp triển khai phương pháp này hợp lý và đạt kết quả tốt nhất.

Ưu điểm

Transfer Learning giúp tận dụng mô hình đã huấn luyện trước, tiết kiệm thời gian và nguồn lực, đồng thời nâng cao khả năng tổng quát cho các nhiệm vụ mới:

- Tiết kiệm chi phí và thời gian: Tái sử dụng mô hình đã huấn luyện giúp giảm số lần huấn luyện (epochs) và tài nguyên tính toán cần thiết.

- Hiệu quả với dữ liệu hạn chế: Khi dữ liệu huấn luyện mới còn hạn chế, Transfer Learning vẫn cho phép mô hình học được đặc trưng quan trọng, giảm nhu cầu tạo dữ liệu nhãn thủ công và rút ngắn thời gian thu thập dữ liệu.

- Cải thiện khả năng tổng quát hóa: Huấn luyện lại mô hình với dữ liệu mới giúp nó học được đặc trưng đa dạng từ nhiều tập dữ liệu, giảm nguy cơ overfitting và nâng cao khả năng áp dụng thực tế.

- Tăng độ chính xác và tốc độ hội tụ: Mô hình bắt đầu từ kiến thức đã học có độ chính xác tốt hơn ngay từ đầu, tốc độ hội tụ nhanh hơn và đạt mức hiệu suất tối ưu cao hơn so với việc huấn luyện từ đầu.

Nhược điểm

Mặc dù có nhiều lợi ích, Transfer Learning vẫn tồn tại một số hạn chế cần lưu ý để tránh rủi ro và khai thác hiệu quả tối đa:

- Nguy cơ chuyển giao tiêu cực: Nếu nhiệm vụ gốc và nhiệm vụ mới không tương đồng, mô hình có thể áp dụng sai kiến thức cũ, dẫn đến hiệu suất kém hơn so với việc huấn luyện từ đầu.

- Giới hạn về miền dữ liệu (domain): Transfer Learning hoạt động tốt nhất khi dữ liệu nguồn và dữ liệu mới có đặc điểm tương đồng. Nếu sự khác biệt quá lớn, các đặc trưng học được từ mô hình gốc sẽ ít hữu ích hoặc không áp dụng được.

- Phụ thuộc vào chất lượng mô hình gốc: Mô hình tiền huấn luyện cần phải đủ mạnh và được huấn luyện trên dữ liệu phong phú. Nếu không, kiến thức chuyển giao sẽ hạn chế và hiệu quả mô hình mới giảm.

- Không khắc phục được dữ liệu chất lượng thấp: Transfer Learning không thể thay thế cho dữ liệu kém chất lượng. Các bước tiền xử lý, tăng cường dữ liệu và trích xuất đặc trưng vẫn cần thực hiện để đảm bảo kết quả tốt.

- Thiếu tiêu chuẩn đánh giá sự tương đồng giữa nhiệm vụ: Hiện chưa có tiêu chuẩn phổ biến để xác định độ liên quan giữa nhiệm vụ gốc và nhiệm vụ mới, khiến việc quyết định áp dụng Transfer Learning đôi khi khó khăn và mang tính thử nghiệm.

Kết luận

Transfer Learning là gì? Đây là phương pháp học máy hiện đại cho phép tận dụng tri thức từ các mô hình đã huấn luyện trước để giải quyết bài toán mới. Cách tiếp cận này giúp tiết kiệm thời gian, chi phí, đồng thời tăng độ chính xác ngay cả khi dữ liệu hạn chế. Chính vì vậy, Transfer Learning đang trở thành một xu hướng quan trọng và được ứng dụng rộng rãi trong lĩnh vực trí tuệ nhân tạo hiện nay.

Về trang chủ Bizfly

Về trang chủ Bizfly

Đăng nhập

Đăng nhập

Tài liệu kỹ thuật AI Chat

Tài liệu kỹ thuật AI Chat

Loading ...

Loading ...